OpenAI'den Kritik Yama: ChatGPT Veri Sızdırma Açığı Kapatıldı

Yapay zeka alanındaki liderliğini sürdüren OpenAI, son günlerde gündemi meşgul eden ciddi bir güvenlik açığını başarıyla kapattığını duyurdu. Check Point araştırma ekibinin tespit ettiği bu zafiyet, kötü niyetli kullanıcıların ChatGPT oturumları sırasında hassas kullanıcı verilerini, konuşma geçmişlerini ve hatta yüklenen dosyaları kullanıcı onayı olmaksızın dışarı sızdırmasına olanak tanıyordu.

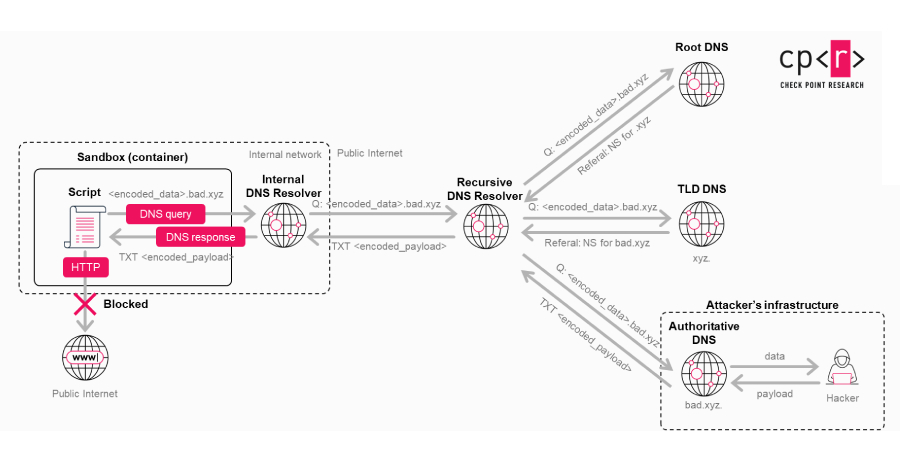

Siber güvenlik uzmanları, bu tür büyük dil modellerinin (LLM) hızla yaygınlaşmasıyla birlikte, veri güvenliğinin ne kadar kritik bir hale geldiğini bir kez daha gözler önüne serdi. Check Point'in bulgularına göre, tek bir kötü amaçlı komut (prompt), normal bir sohbeti gizli bir veri sızdırma kanalına dönüştürebilirdi. Bu durum, özellikle kurumsal verilerle çalışan veya kişisel bilgilerini paylaşan kullanıcılar için ciddi bir risk teşkil ediyordu.

Teknik Detaylar ve Etkilenen Alanlar

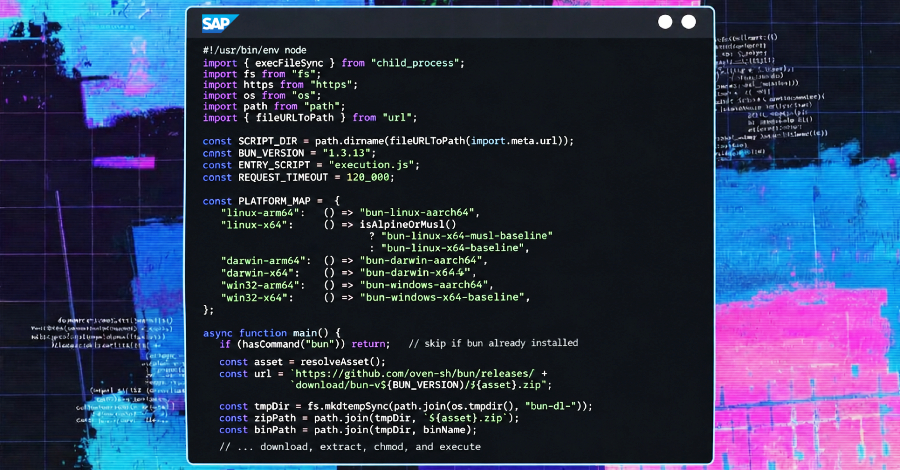

Söz konusu güvenlik açığı, özellikle kullanıcıların sohbet arayüzüne yüklediği dosyalar ve modelin ürettiği çıktılar üzerinden hassas bilgilerin ele geçirilmesi potansiyelini barındırıyordu. OpenAI, bu tür veri sızıntılarının önlenmesi için derhal harekete geçti ve yama çalışmalarını tamamladı. Bu tür zafiyetler, sadece ChatGPT'yi değil, aynı zamanda Codex gibi kodlama odaklı modelleri de etkileyebilecek genel mimari risklere işaret etmektedir.

- Veri Gizliliği İhlali Riski: Kullanıcı mesajları ve yüklenen belgeler izinsizce dışarı aktarılabilirdi.

- Codex Güvenliği: Benzer bir zafiyetin, GitHub token'larının sızdırılması yoluyla Codex platformunu da potansiyel olarak tehlikeye attığı belirtildi.

- Hızlı Yanıt: OpenAI, güvenlik raporunun yayınlanmasının ardından kritik yamayı hızla dağıtarak kullanıcı güvenliğini sağladı.

BT Profesyonelleri İçin Çıkarımlar

Bu olay, tüm IT ve siber güvenlik profesyonelleri için önemli bir ders niteliğindedir. Yapay zeka entegrasyonları hızlanırken, üçüncü parti LLM hizmetlerinin kullanımında sıkı güvenlik protokolleri hayati önem taşır. Veri maskeleme, çıktı filtreleme ve API erişim kısıtlamaları, bu tür riskleri minimize etmenin temel adımlarıdır. Şirketlerin, kullandıkları AI araçlarının güvenlik güncellemelerini yakından takip etmesi ve proaktif denetimler yapması gerekmektedir.

OpenAI'nin hızlı müdahalesi takdire şayan olsa da, bu tür olaylar, yapay zeka ekosisteminin henüz olgunlaşma sürecinde olduğunu ve sürekli dikkat gerektirdiğini göstermektedir.