Yapay Zeka Devriminde Güvenin Sınırları

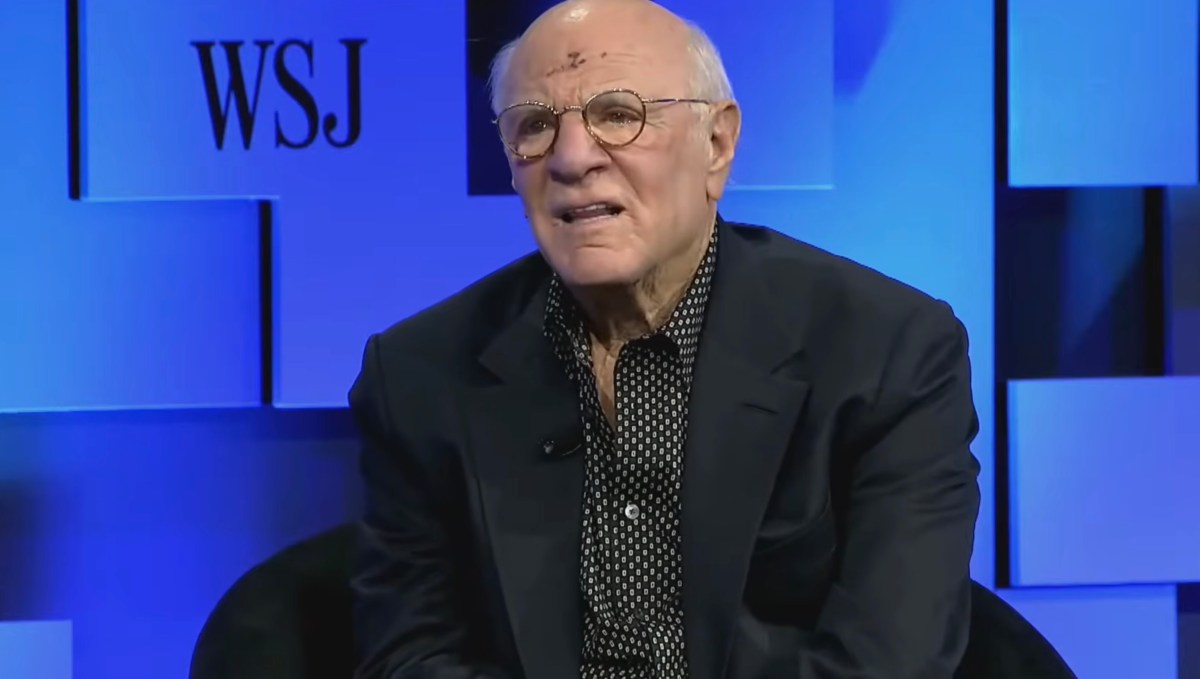

Teknoloji dünyasının deneyimli isimlerinden Barry Diller, geçtiğimiz günlerde OpenAI CEO'su Sam Altman’a olan kişisel güvenini yineledi. Ancak Diller’ın açıklamaları, sadece bireysel güvenin ötesine geçerek Yapay Genel Zeka (AGI) çağının getirdiği belirsizliklere odaklanıyor. Diller'a göre, teknoloji şirketlerinin liderlerine duyulan güven, AGI'nin kontrol edilemez potansiyeli karşısında ikincil bir öneme sahip.

AGI Neden Bir Dönüm Noktası?

AGI, sadece daha gelişmiş bir yapay zeka değil, insan zekasına eşdeğer veya onu aşan bir sistem olarak tanımlanıyor. Diller, bu noktada şu kritik uyarıları yapıyor:

- Öngörülemezlik: AGI, kendi kendini geliştirebilen bir yapıya sahip olduğu için geleneksel yazılım mantığının ötesine geçebilir.

- Denetim Mekanizmaları: Güven, yazılım kodlarının veya etik standartların yerini tutamaz. Sıkı güvenlik duvarlarına ve yasal düzenlemelere ihtiyaç var.

- Toplumsal Etki: AGI'nin ekonomik ve etik etkileri, bireysel liderlik kararlarından çok daha geniş bir etki alanına sahip.

Diller, Altman'ı desteklese de, sistemin kendi kendini düzenlemesinin yeterli olmayacağını, devletlerin ve bağımsız denetleyici kurumların bu sürece dahil olması gerektiğini savunuyor. IT profesyonelleri ve teknoloji liderleri için bu durum, 'güven ama doğrula' prensibinin kurumsal ve sistemsel düzeyde yeniden tanımlanması anlamına geliyor.

Geleceği İnşa Ederken Güvenlik Öncelikli Yaklaşım

Şirketler AGI çözümlerini entegre ederken, sadece teknoloji sağlayıcılarına güvenmek yerine, kendi iç güvenlik protokollerini ve etik yapay zeka politikalarını oluşturmalıdır. Barry Diller'ın vurguladığı gibi, 'güvenin ilgisiz kaldığı' bir noktaya hızla yaklaşıyoruz. Bu nedenle, şeffaflık, izlenebilirlik ve sağlam bir denetim mekanizması, dijital dönüşümün temel taşları olmalıdır. Gelecek, sadece en akıllı algoritmaları geliştirenlerin değil, bu algoritmaları güvenli bir şekilde yönetebilenlerin olacaktır.